O mercado de tecnologia passa por um momento decisivo onde a eficácia dos modelos de Inteligência Artificial não é medida apenas pela arquitetura do algoritmo, mas pela robustez de sua operação em escala para atender o cliente. Priorizar seus dados em projetos de IA e ML se mostrou ser uma forte aliada para evitar problemas nos seus produtos.

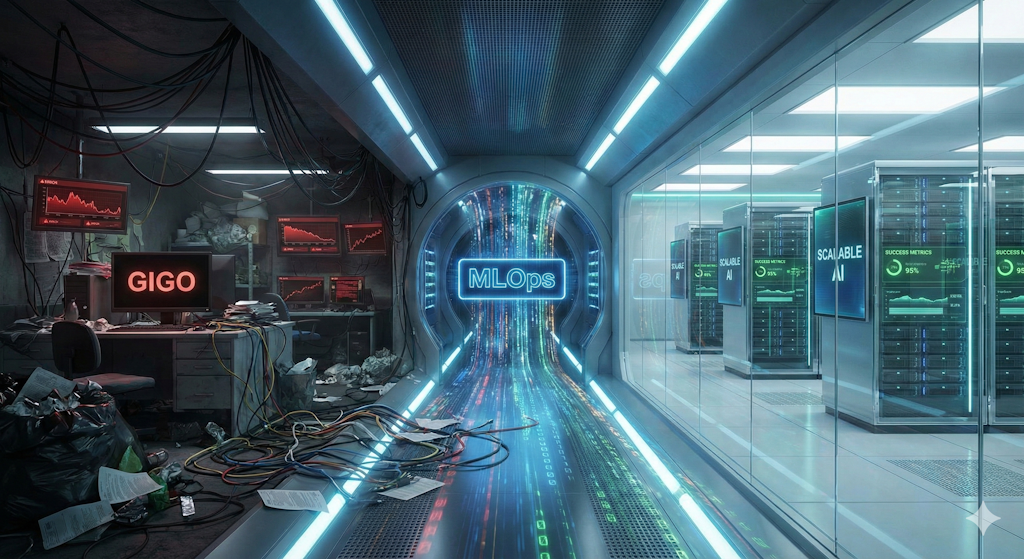

Quero destacar neste texto quem são os profissionais impactados por essa mudança e por que a negligência na qualidade dos dados estruturados pode levar ao fracasso de projetos em produção. Falo sobre o uso estratégico de Data Augmentation em séries temporais e os perigos silenciosos dos dados ruins, conhecidos como “Garbage In –> Garbage Out”. Além disso, conto como o MLOps surge como uma resposta factível para mitigar Drifts e garantir a escalabilidade.

Estratégias de Data Augmentation em dados estruturados

A técnica de Data Augmentation é amplamente difundida em projetos de visão computacional, audio analytics e mineração de texto, porém, sua aplicação em dados estruturados exige uma abordagem muito mais cautelosa e científica. Especialmente em cenários de Análise de Séries Temporais Históricas, a geração de dados sintéticos não pode ser aleatória. Contudo, para garantir que o aumento de dados beneficie o modelo, devemos seguir princípios eficientes.

- O primeiro deles é o Princípio da Preservação. Este conceito dita que devemos preservar o significado semântico dos dados originais durante qualquer transformação. Se uma alteração modifica o rótulo ou a essência da informação, não estamos aumentando os dados, mas sim corrompendo ou envenenando aquele dado;

- Além disso, temos o Princípio da Distribuição. As variações introduzidas no conjunto de treinamento devem representar flutuações realistas que o modelo encontrará no ambiente de produção. Criar cenários impossíveis apenas confunde o algoritmo e degrada sua capacidade de generalização;

- Por fim, aplicamos o Princípio da Medição. Modelos de aprendizado profundo submetidos a um aumento de dados correto devem apresentar métricas superiores. Portanto, esperamos melhorias tangíveis na perda de treinamento, na precisão e na validação geral em comparação com modelos treinados sem essa técnica.

O custo oculto da baixa qualidade dos dados

Muitas equipes de ciência de dados concentram seus esforços excessivamente na seleção de arquiteturas complexas de redes neurais e negligenciam a matéria-prima básica: os dados. Esse descuido resulta em um fenômeno perigoso conhecido como GIGO – Garbage In: Garbage Out. Basicamente, se um modelo consome dados ruins durante o treinamento, ele inevitavelmente gerará previsões ruins, independentemente da sofisticação do algoritmo. O problema se agrava porque existe, frequentemente, uma discrepância significativa entre os dados limpos usados em ambiente controlado de desenvolvimento e os dados caóticos do mundo real.

Essa diferença de ambiente propicia o surgimento de falhas críticas. O Data Drift ocorre quando as propriedades estatísticas dos dados de entrada mudam ao longo do tempo, tornando o modelo obsoleto. Similarmente, o Model Drift acontece quando a relação entre as variáveis de entrada e a saída desejada se altera. Além disso, existe o risco de Data Poisoning, onde dados corrompidos são inseridos intencionalmente ou acidentalmente no fluxo de treinamento. Portanto, sem um monitoramento constante da qualidade dos dados rotulados, as métricas de sucesso obtidas no treinamento tornam-se irrelevantes quando o sistema entra em produção.

MLOps: Uma resposta para escalar com segurança

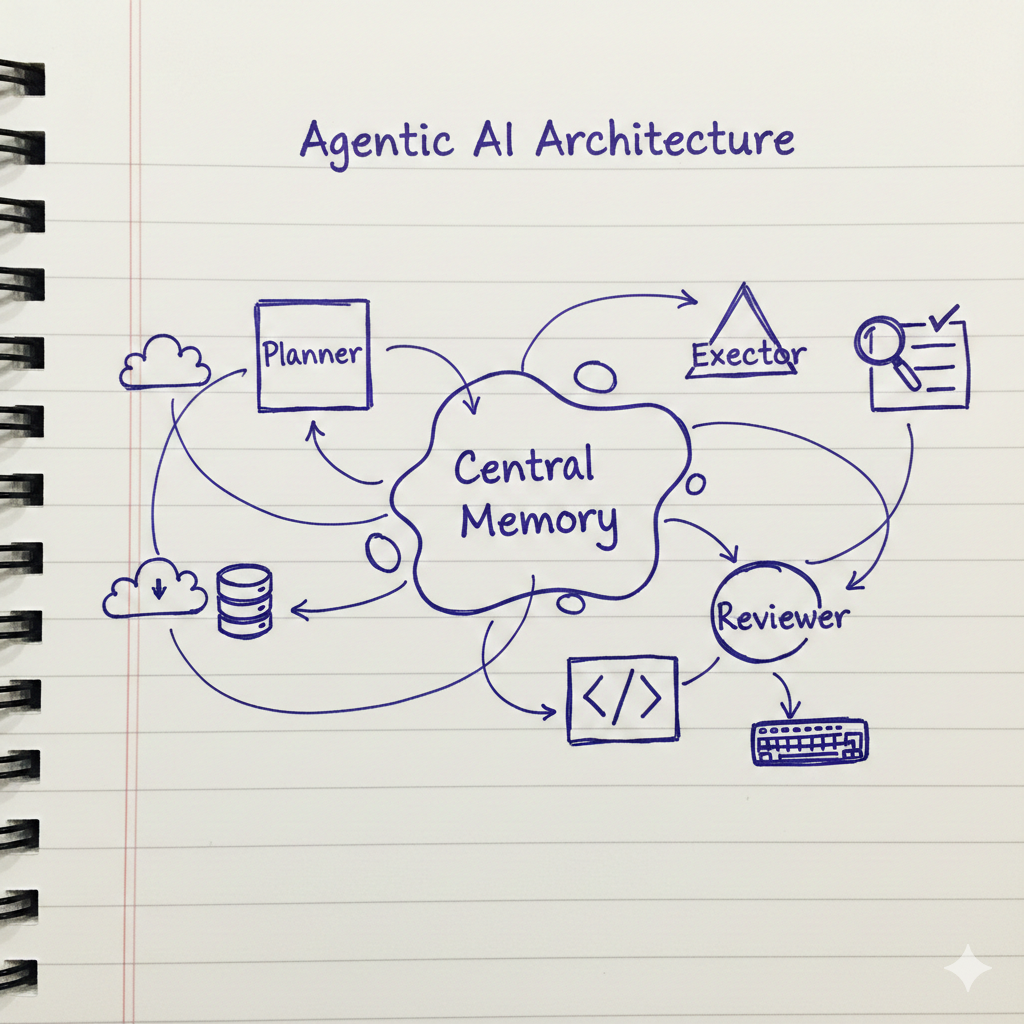

Diante dos riscos apresentados pelo aumento de dados mal executado e pela degradação da qualidade dos dados, a adoção de Machine Learning Operations (MLOps) torna-se quase que mandatória! Cientistas de dados, por natureza, focam na precisão estatística e na descoberta de padrões. No entanto, eles raramente priorizam questões de infraestrutura, como latência, aumento de chamadas de sistema ou escalabilidade de endpoints. É aqui que o MLOps atua, criando uma base sólida para que a ciência de dados atenda a demanda de negócio, em conjunto com as questões de operações de TI e da engenharia de software.

Empresas maduras utilizam MLOps para automatizar o ciclo de vida do modelo. Isso inclui pipelines automatizados que validam a qualidade dos dados antes mesmo do retreino começar. Dessa forma, garantimos que os princípios de preservação e distribuição do Data Augmentation sejam respeitados em cada iteração.

Além disso, sistemas de MLOps implementam monitoramento em tempo real para detectar drifts imediatamente. Assim, quando o modelo em produção começa a divergir do comportamento esperado devido a mudanças no comportamento do consumidor ou do mercado, o sistema pode alertar a equipe ou até iniciar um retreino automático. Consequentemente, a aplicação ganha estabilidade e capacidade de atender a uma demanda crescente de usuários sem colapsar.

Contexto de mercado

A refatoração de modelos estáticos para sistemas dinâmicos gerenciados por MLOps não é apenas uma capricho técnico, mas uma necessidade de sobrevivência corporativa. Não podemos nos dar o luxo de subir modelos em produção que respondam errado para nossos clientes.

Grandes players do mercado já demonstraram que a gestão eficiente de dados e modelos é o segredo para a liderança. Um exemplo disso foi o projeto que atuei no Itaú por alguns anos, para a construção da plataforma de MLOps em parceria com a AWS. Os resultados foram significativos e mudaram o patamar da plataforma de ciência de dados do banco.

Outro exemplo, a Uber, com sua plataforma Michelangelo, estabeleceu um padrão ouro ao permitir que modelos de previsão de demanda e tempo de chegada fossem atualizados e monitorados em escala global. Sem essa infraestrutura de MLOps, a Uber não conseguiria lidar com o Data Drift causado por eventos de trânsito em tempo real ou mudanças climáticas repentinas.

Outro exemplo notável é a Netflix. O sistema de recomendação da empresa depende inteiramente de dados comportamentais que mudam a cada segundo. Eles utilizam práticas avançadas de MLOps para garantir que o “envenenamento” de dados ou anomalias isoladas não afetem a experiência de milhões de usuários.

Para os desenvolvedores e a sociedade, isso significa serviços mais confiáveis e personalizados. O impacto no mercado é claro, empresas que insistem em tratar IA como um projeto artesanal, introduzindo tarefas Data Augmentation de forma incorreta e sem monitoramento de dados, perderão competitividade rapidamente para aquelas que profissionalizam seus processos de IA.

Priorize seus dados nos projetos de IA e ML

Na minha visão, a implementação de modelos de IA e ML em produção exige muito mais do que código limpo, algoritmos modernos e um time de ciência de dados para chamar de seu. Entendo que isso exige uma mudança de mentalidade voltada para a governança de dados. Comentei mais acima que as técnicas de Data Augmentation em dados estruturados podem ser poderosas, desde que respeitem os princípios de preservação e distribuição. Contudo, mesmo assim, o risco do GIGO permanece como uma ameaça constante que pode destruir o valor de negócio de qualquer iniciativa de IA. Priorize seus dados nos projetos de IA e ML!

A adoção de MLOps não deve ser vista como um custo adicional de infraestrutura, mas como um seguro contra a obsolescência, o erro e o caos dos sistemas em produção. A capacidade de detectar drifts nos dados e escalar operações de forma automatizada é o que separa provas de conceito interessantes de produtos digitais lucrativos e resilientes. E sem contar, é claro, que irá economizar rios de dinheiro ao se implementar de forma correta.

A imagem de capa foi feita com o Google Nano Banana 3, com o prompt: Na esquerda mostra um laboratório caótico com lixo “GIGO” e gráficos de erro vermelhos. Centro traz uma ponte tecnológica com uma placa “MLOps” filtrando e organizando dados. Direita revela um data center futurista e limpo com métricas de sucesso verdes. A composição da imagem deve ser fluída e contínua, indicando que a saída do caos da esquerda para chegar ao sossego do lado direito, é através da ponte de MLOps do centro. Aplique estilo fotorrealista, iluminação cinematográfica, simbolizando a transformação de dados ruins em IA escalável.